Balance 2019: UART

El año que termina nos deja para el Sistema de Riesgos del Trabajo un panorama dual. Por un lado, se siguen manteniendo sus índices y estándares de cobertura, las acciones de prevención, servicios y prestaciones. Por otro, sin embargo, no termina de cerrarse el peligroso capítulo de la litigiosidad que, en 2018, parecía haber entrado en cauce de resolución.

Gestión. Respecto de los datos de gestión, 2019 encontró a las aseguradoras cubriendo a casi 10 millones de trabajadores que se desempeñan en 1 millón de empresas. En este complejo y diverso universo, las acciones de prevención, permitieron seguir disminuyendo la cantidad de siniestros. De hecho, los fallecimientos, desde el inicio del sistema, bajaron un 76% considerando aquellos ocurridos en el lugar del trabajo y 71% si se consideran los accidentes in itinere. Esto va más allá de ser un simple porcentaje de gestión y no es un dato menor. Significa 13 mil vidas salvadas en este período por la acción combinada de empleadores, trabajadores, aseguradores y el Estado.

Cabe agregar que el sistema argentino en comparación con otros semejantes como el de Chile o el de España ofrece mayores resarcimientos. Reconoce el pago del 100% del salario durante las incapacidades laborales temporarias, mientras que en España solo se cubre 75%. Asimismo, ese país indemniza solo incapacidades superiores al 33% y Chile al 15%, mientras que aquí la cobertura es total, sin exclusiones de ningún tipo. Sin embargo, a pesar de contar con estos claros beneficios, el índice de litigiosidad en nuestro país supera ampliamente a los otros dos. Este dato debería llevarnos a la reflexión de la incongruencia de cobertura más amplia trae aparejadas más demandas.

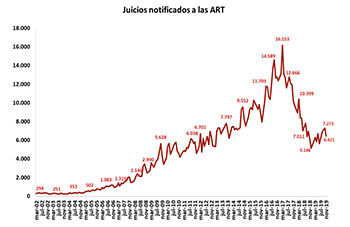

Juicios. En tal sentido, en cuanto a nuevos reclamos judiciales, 2019 comenzó con buenas expectativas. En 2017 se había alcanzado la friolera de 130.000. La sanción de la nueva ley permitió reducir ese número a 80 mil en 2018. Y se esperaba que esa tendencia descendente se mantuviera. Pero, lamentablemente hacia mitad de año comenzó a hacerse más visible una reversión que, con el correr de los meses, se fue consolidando en algunas.

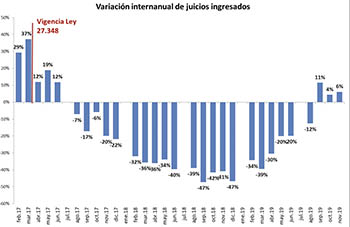

En el mes de noviembre/19 se notificaron a las ART 6.421 juicios, acumulando 62.132 nuevos juicios en el año, representan respectivamente un aumento del 6,1% contra noviembre/18 (6.054 juicios) y una caída de solo 17,0 % en cuanto al acumulado de los primeros once meses del año 2018 (74.878 juicios). Cifras que marcan un claro cambio de la tendencia a la disminución de la litigiosidad. En efecto, en septiembre + 11% y en octubre + 4%. El estimado de diciembre también confirmaría el movimiento al alza.

Para mostrar la reversión se adjunta el gráfico en el que se contrasta la variación de cada mes respecto de igual período del año anterior en cada caso.

En los primeros 11 meses del año se acumularon 62.132 nuevos juicios, un número sumamente elevado. El estimado para diciembre llevaría esta cifra a 68.000. Los datos expuestos nos alertan respecto de una clara reversión: las demandas habrían encontrado su piso en junio, período a partir del cual comenzaron a repuntar.

Solución. Este dato contundente refuerza claramente la necesidad de completar el cumplimiento de lo previsto en la Ley 27.348 a través de la constitución inmediata de los Cuerpos Médicos Forenses (CMF), en cada una de las justicias de las 15 provincias adheridas a la Ley. Este eslabón faltante, previsto en la reforma para consolidar el camino recorrido de baja de litigiosidad, reabre la puerta al retorno de la litigiosidad exacerbada. La no constitución de los CMFs implica que el mecanismo pericial sigue con honorarios acoplados a los montos de las sentencias (contundente incentivo a sobreestimar daños) y sin la utilización o una utilización incorrecta del Baremo (tabla de Porcentajes de incapacidades). Esta dilación constituye una vía directa al aumento de la litigiosidad. Permite no sólo el crecimiento del número de demandas, sino también el aumento del costo de las mismas. Resulta además llamativo que el valor de los juicios ingresados siga siendo elevado, tanto en comparación con períodos anteriores a la escalada de juicios, como en relación con las incapacidades permanentes. Afecta además la valuación de juicios en stock, agravando el pasivo contingente de juicios del sistema.

La problemática se encuentra a su vez exacerbada por aplicación de diferentes versiones de la tasa de interés activa BNA (hoy en el 60% anual) a la cual se ajustan como piso la mayoría de los juicios. Tal desproporcionado sobrecosto atenta contra la vida del sistema porque lo desfinancia. No hay prima, ni rendimientos de inversión posible para financiar tal desfasaje.

Conclusión. Asistimos una vez más a un fenómeno en el cual la tarea de prevención disminuye el número de fallecidos y de siniestros y las prestaciones aumentan y mejoran, y sin embargo, la litigiosidad paradojalmente crece. Los números expuestos llevan a reflexionar respecto de lo que la dilación en la creación de los Cuerpos Médicos Forenses, genera para el sistema, colocándolo en peligroso escenario de desfinanciamiento evitable y su enorme impacto en la economía de un país que necesita dejar de encontrar obstáculos subsanables para impulsar su crecimiento.

| El aprendizaje automático llegó para quedarse

"La IA ya está comenzando a transformar la forma en que las organizaciones hacen negocios, gestionan sus relaciones con los clientes y estimulan las ideas y la creatividad que impulsan la innovación innovadora" (Capgemini)

Hace tres años, los buenos casos de uso para el aprendizaje automático eran difíciles de encontrar. Ahora, las historias de éxito están en todas partes. El aprendizaje automático, el aprendizaje profundo, las redes neuronales y todas las demás variantes ahora son abundantes. Entonces, pase lo que pase este año, el aprendizaje automático está aquí para quedarse, y será aún más exitoso a medida que más empresas comiencen a usar IA para sus actividades diarias.

Todos estos algoritmos de IA ahora constituyen una parte integral de muchas herramientas basadas en datos. Para los analistas de datos, usar la inteligencia artificial está a solo un clic de distancia. ¿Pero esto implica que la IA se usa correctamente? Me temo que no, porque:

La calidad de los datos sigue siendo un problema importante. Sin la calidad de los datos, el sesgo y los prejuicios están a la vuelta de la esquina y la salida de la IA no será precisa. La calidad y la ética de los datos están entrelazadas. La ética a menudo se considera algo extra, pero debe estar en la base de cualquier implementación de IA, o, para el caso, en el corazón de cualquier otro proyecto de big data. Todavía no hay suficiente enfoque en la calidad de los resultados de la IA. Los métodos estadísticos como la precisión, la precisión, la recuperación y la definición F1 son definitivamente buenos indicadores. Pero aún necesitamos una barra para medir. Muchas organizaciones realmente no tienen idea de cómo medir la calidad de las decisiones que toman.

Pero hay más en los procesos comerciales que la ejecución de tareas. ¿Cómo podemos determinar si nuestra IA es realmente una mejora sobre las acciones basadas en humanos? Esto sigue siendo una discusión abierta.

Actualmente, vemos que el aprendizaje automático se usa en aplicaciones muy estrechas, para hacer que los pasos del proceso sean más eficientes o para aliviar trabajos tediosos. Pero cómo la IA contribuirá a un retorno significativo de la inversión también ha sido una gran pregunta, tanto el año pasado como en 2020.

Las discusiones sobre ética continuarán

“La ética de la inteligencia artificial no es solo un complemento para sentirse bien, un deseo, pero no una necesidad. La IA ha sido considerada uno de los grandes desafíos de derechos humanos del siglo XXI ". (Khari Johnson)

El año pasado, las discusiones sobre la ética de la IA realmente despegaron. Aunque principalmente académica, la discusión ahora se centra no solo en las consecuencias (im) morales de la IA, por ejemplo, la discriminación, la pérdida de empleo, la desigualdad, etc. El enfoque ahora está en los valores. ¿Hay algo como " AI para bien "? Como sociedad ¿realmente queremos dar poderes decisivos a las máquinas? ¿Y esas máquinas son justas y abiertas? ¿Y qué hay de los cheques y saldos?

Estas discusiones no se centran solo en la IA. También se refieren al uso de big data. Ciudades inteligentes, reconocimiento facial, detección de fraude: estas son todas las áreas donde se debe discutir y evaluar la privacidad y la conveniencia. Esto requerirá la evaluación del lado ético desde el comienzo del proyecto. ¿Será la ética de la IA un deber oneroso o una verdadera ventaja competitiva? No lo sé todavía.

Veremos el surgimiento de marcos éticos. Al igual que los marcos de cumplimiento para la contabilidad, estos marcos ofrecerán formas de evaluar las implicaciones éticas de la IA. Como cualquier marco, no son excusa para no pensar de manera independiente y sistemática sobre la IA. Los marcos no garantizan un buen resultado. Y surgirá la discusión sobre cómo utilizar estos marcos en un contexto empresarial.

Mi reciente blog de tres partes sobre ética describe un enfoque para implementar la ética para la IA en productos, servicios y empresas.

Alcanzando el conocimiento

“En cambio, el aprendizaje profundo nos ha dado máquinas con habilidades realmente impresionantes, pero sin inteligencia. La diferencia es profunda y radica en la ausencia de un modelo de realidad ". (Judea Pearl)

El aprendizaje automático, incluido el aprendizaje profundo y las redes neuronales, es muy exitoso. Todos estos métodos son muy buenos para extraer información de los datos. Sí, soy consciente de los numerosos errores que comete el aprendizaje automático y de cómo puede engañarse el aprendizaje automático, principalmente el reconocimiento de imágenes. Debemos aprender de estos errores mejorando los algoritmos y los procesos de aprendizaje. Pero la IA es mucho más que el aprendizaje automático solo. La computación cognitiva, la IA simbólica y el razonamiento contextual también son IA. Necesitamos reevaluar el uso de estas otras técnicas de IA para nuestras aplicaciones.

Este año, continuaremos abriendo la caja negra de aprendizaje automático. Los algoritmos, a través del aprendizaje automático interpretable, proporcionarán información sobre cómo llegaron a sus decisiones. Pero la IA en un contexto empresarial no podrá evaluar la corrección y la imparcialidad de las decisiones.

El aprendizaje automático es bueno para extraer información de los datos, pero es pésimo para extraer conocimiento de la información. Para que los datos se conviertan en información, deben ser contextualizados, categorizados, calculados y condensados. La información es clave para el conocimiento. El conocimiento está estrechamente relacionado con el hacer e implica conocimiento y comprensión. Esto plantea la pregunta filosófica de décadas de la IA: "¿Los sistemas de IA realmente entienden lo que están haciendo?"

Sin volver a visitar la Sala China de John Searle, realmente creo que el siguiente paso en la IA solo se puede dar una vez que incorporamos cierto nivel de conocimiento o comprensión de la IA. Para hacer eso, tendremos que dar un paso más hacia la IA humana. Por ejemplo, mediante el uso de IA simbólica (o IA clásica). Esta es la rama de la investigación de IA que se ocupa de intentar representar explícitamente el conocimiento humano en una forma declarativa (es decir, hechos y reglas). La combinación de estas técnicas más antiguas con redes neuronales en una forma híbrida llevará a la IA aún más lejos. Esto significa que la causalidad, la representación del conocimiento, etc., son factores clave necesarios para llevar la IA al siguiente nivel, un próximo nivel que será aún más emocionante que los logros que la IA ha alcanzado este año.

Por Reinoud Kaasschieter |